De prijs van onze gratis AI-tools: werknemers zonder rechten of zichtbaarheid

Wie denkt dat generatieve AI vanzelf werkt, vergist zich. Achter de chatbots en beeldgeneratoren schuilen ruim 150 miljoen mensen die AI-systemen draaiende houden, onder vaak slechte omstandigheden. Studenten van de Associate degree Smart Media Production hoorden onlangs de ervaringen van experts met dit onderwerp bij FLOOR HvA. Ook luisterden zij naar de getuigenissen van datawerkers.

In de Associate degree Smart Media Production(opent in nieuw venster) leren studenten om gepersonaliseerde, digitale content te maken voor mediabedrijven. Voor studie-opdrachten maken zij vaak gebruik van generatieve AI.

Over de ethische kanten van ons technologiegebruik krijgen zij wekelijks college (de ‘Smart Gen Club’). Een speciale editie hiervan was het event Ghostwork: de onzichtbare arbeid achter AI (video) bij cultureel platform FLOOR van de Hogeschool van Amsterdam.

Onzichtbaar gemaakt

“Wie van jullie wist dat er zoveel menselijke arbeid nodig is voor AI?” vraagt docent Tessa Duzee aan de zaal vol studenten. Vrijwel niemand steekt zijn hand op. Voor veel mensen blijft AI een ‘black box’, een soort magie. De techbedrijven houden dat beeld graag hoog.

Aan de achterkant, zo zien de studenten, is weinig magie te beleven. In landen als Kenia en Ghana maken datawerkers lange dagen waarin zij bijvoorbeeld gewelddadige beelden moeten beoordelen, hun webcam niet mogen uitzetten en bij één foutje niet betaald krijgen voor de uren daarvoor.

Bewust buiten beeld gehouden

Onderzoeker Martijn Arets (HvA-lectoraat Civic Interaction Design) vertelt hoe deze groep arbeiders, naar schatting 150 tot 430 miljoen wereldwijd, bewust buiten beeld wordt gehouden door big tech. “Want zij willen geen verantwoordelijkheid afleggen en opereren het liefst in een regelarm vacuüm.”

Er zijn grofweg drie soorten datawerk: het trainen van AI door grote hoeveelheden content te 'annoteren' (labelen, soms schokkend materiaal) , het controleren van AI-uitkomsten, en het ‘impersonaliseren’. Bij dit laatste denkt de gebruiker met AI te dealen, terwijl het in feite mensen zijn die antwoord geven of meekijken.

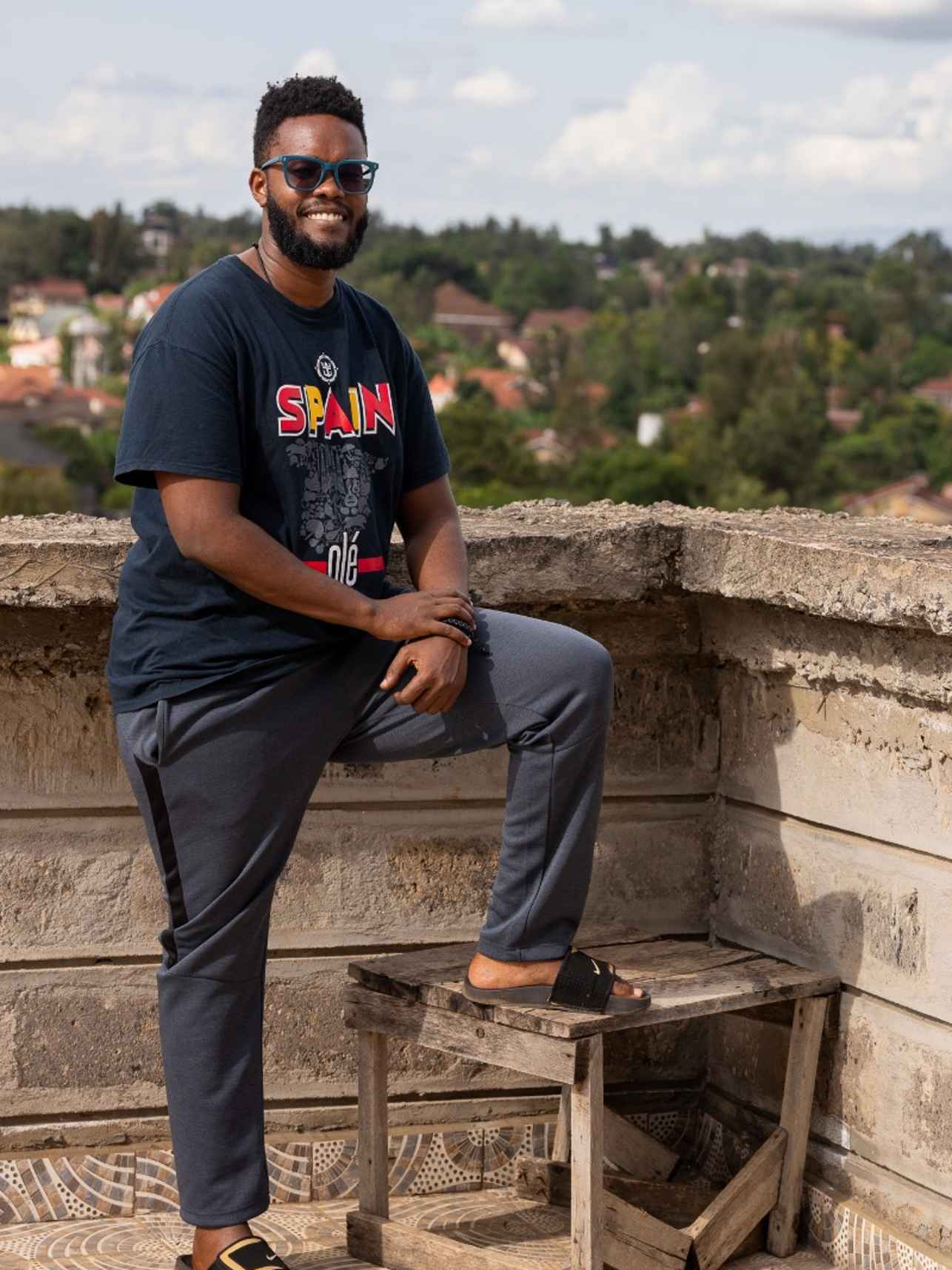

Ephantus vertelt over datawerk - video Martijn Arets

Mensen bedienden Amazons ‘AI-supermarkt’

Arets geeft een voorbeeld van dit laatste: in 2021 opende Amazon in de VS ‘compleet door AI-gerunde supermarkten’. In feite zaten 1.000 mensen in India mee te kijken om dit proces te begeleiden, zodat Amazon hier AI kon faken.

Arets sprak zelf ook datawerkers in Kenia over hun arbeidsomstandigheden, onder wie Ephantus Kanyugi uit Kenia (foto). De emotionele druk is hoog – contentmoderatoren kampen vaak met PTSS - maar het is vaak ook erg geestdodend werk. “Tegelijk doen mensen ontzettend hun best om dit werk goed te doen, hoe slecht ze ook betaald worden.”

Onze AI draait op uitbuiting

Mensen willen het werk niet kwijt, maar ze willen betere omstandigheden. Dat benadrukt ook Fiona Dragsta van de WageIndicator Foundation. Uit hun onderzoek blijkt dat werkenden in de ‘global south’ regelmatig 10 keer minder verdienen dan nodig is voor een menswaardig bestaan.

Verantwoordelijkheid afschuiven

“OpenAI en Google AI schuiven alle verantwoordelijkheid van zich af”, constateert Fiona. Dat doen ze heel vernuftig: ze werken via Business Process Outsourcing-bedrijven (BPO’s) of online werkplatformen, zodat ze zelf geen verantwoordelijkheid hoeven dragen. Overheden leggen deze BPO’s geen strobreed in de weg, omdat ze daarmee Open AI en Meta binnenhalen.

Maar zodra werkenden zich beginnen te organiseren, zoals in Kenia in de Data Labelers Association, verplaatsen de tech-bedrijven hun activiteiten razendsnel naar landen als Filipijnen of Indonesië.

Techbedrijven stevig beschermd

“Waarom zijn er op dit gebied geen rechtszaken wereldwijd?” wil een student weten.

De meeste grote techbedrijven zitten in de VS, en worden daar stevig beschermd door de Amerikaanse overheid”, legt Dragstra uit. “Er zijn wel een aantal EU-politici, zeker bij de Groenen, die proberen om Big Tech zich aan Europese regelgeving te laten houden, maar het wordt hen heel moeilijk gemaakt.”

Maar bekendheid helpt wel, benadrukt Fiona – het creëert druk, en druk zorgt uiteindelijk voor verandering.

Tegenbeweging

Willen we blijven meedraaien in een AI-systeem waarin datawerkers onder erbarmelijke omstandigheden modellen voeden met zoveel informatie, die lang niet altijd van waarde is?

Nanda Piersma, wetenschappelijk directeur van het Centre of Expertise Applied AI, benadrukt het belang van kritisch bewustzijn hierover. “Moeten we alles wat waardevol is eigenlijk wel uitbesteden aan AI?”

Ze vertelt dat verantwoorde alternatieven worden ontwikkeld, en roept studenten op om als contentmakers verandering op gang te helpen brengen. Bijvoorbeeld door waardevolle content, zoals de verhalen van datawerkers, zichtbaar te maken tegenover de ‘rommel’ van big tech.

In hun opleiding gebruiken studenten dagelijks AI-tools voor video en beeld, meestal de grote, gratis programma’s.

“Hoe kunnen we voor verandering zorgen als bijna alle techbedrijven uit de VS komen?” vraagt student Moos.

Goede alternatieven zijn er nauwelijks, of ze zijn te duur, erkent Piersma. Daarom pleit ze voor investeringen op Europees niveau om de verantwoorde tools die ontwikkeld worden ook echt naar de mensen te brengen.

Studenten en onderzoekers concluderen dat mensen niet vanzelf kiezen voor een verantwoord alternatief; het moet ook iets extra’s bieden, een unique selling point, zoals duurzame mode dat heeft tegenover fast fashion. Piersma: “We moeten in Europa een manier vinden om verantwoorde IT waardevol te maken.”

Student Max merkt tot slot op dat hij in de opleiding graag nog dieper wil ingaan op hoe je echt die alternatieven kunt bieden. Zodat er niet alleen hier, maar ook daar wat verandert.

_____________________

Reacties studenten

Stijn Smit:

"We hebben het in lessen veel gehad over de juridische en ethische kanten van AI, maar nog niet echt over de datawerkers. Dat mensen na een fout niet betaald kregen, vind ik echt ongehoord; daar schrok ik erg van. Het schept een beeld van wetteloosheid. Je ziet dat het patroon van de Industriële revolutie zich nu herhaalt; waarbij de grote techbedrijven verantwoordelijk zijn en mensen de prijs betalen. Dit veranderen – ja, die verantwoordelijkheid voel ik wel als maker.”

Elvin Spooren:

“Ergens weet je wel dat alles rond AI wat te mooi lijkt om waar te zijn, maar ik wist eigenlijk nog niet hoe het zat met al het schaduwwerk achter AI. Maar is er een alternatief? Op werkgebied is het lastig, maar als individu neem ik mee: wees je bewust van wat je steunt.”

Max Helmantel:

“Dit probleem is ernstig en veelzijdig. Maar het is lastig om van hieruit aan te pakken. Het is naïef om te denken dat ethische data-praktijken of tools met een moreel kompas impact krijgen, zolang Amerikaanse techbedrijven daar geen wettelijke of financiële prikkels voor hebben. Toch ligt er in Europa een kans: als we onze eigen koers bepalen met strengere regelgeving en moreel leiderschap, kunnen we op eigen bodem impact maken – naar onze menselijke standaard.”

Responsible AI bij de HvA

In het Responsible AI Lab kijken onderzoekers wat een AI-systeem verantwoord maakt, en wat je hier als gebruiker, als ontwikkelaar of organisatie aan kunt doen. Ghostwork is recent bekender geworden, en daardoor een relatief nieuwere duiding van verantwoorde AI.

Nanda Piersma: "Het lijkt dweilen met de kraan open, maar het is goed om deze zaken naar voren te halen, en voor organisaties om mee te nemen bij de aankoop en inzet van AI-systemen."

Meer weten?

Bekijk onderstaande video's, of neem contact op met Martijn Arets(opent in nieuw venster) of met docent-onderzoeker Tessa Duzee via t.m.duzee[a]hva.nl.

Frida Mwangi over wat datawerk met mensen doet

Frida Mwangi is oprichter van de Kenya Union of Gig Workers. Interview: Martijn Arets

Ghost Workers

Bekijk de trailer (docu Lisette Olsthoorn)

In the Belly of AI

Bekijk de trailer (docu Antonio Casilli)